Künstliche Intelligenz (KI) im Journalismus: mein Beitrag zur Blogparade 2022

Mensch oder Maschine – bleiben Texte mit KI eine Kuriosität? Oder ist KI der neue Zukunftstrend beim Schreiben?

Kann Künstliche Intelligenz journalistische Texte schreiben?

Das Thema Künstliche Intelligenz ist für mich nicht ganz neu. Schon während meines Biologie-Studiums habe ich diesbezüglich interessante Gespräche geführt. Und auch heutzutage nutze ich sie oft, etwa bei der Hintergrundrecherche. Umso spannender klang für mich das Thema der Blogparade von Nicole Isermann zum Thema „Mensch oder Maschine – bleiben Texte mit KI eine Kuriosität? Oder ist KI der neue Zukunftstrend beim Schreiben?“ (Herbst 2022). Ein guter Grund für einen Blogbeitrag. Wobei ich spezialisierungsbedingt auch cross-mediale Aspekte beleuchten möchte.

KI ist unsichtbar und doch allgegenwärtig

Bei Künstlicher Intelligenz denken zunächst viele an hochentwickelte Roboter, die den Menschen imitieren (sollen). Das mag noch eine Utopie sein, auch wenn so manche Maschine schon einen Eindruck des allzu Menschlichen erwecken kann. Meistens jedoch bleibt die KI noch im Verborgenen, ist kaum zu sehen. Sie sucht bei Social Media oder Streamingdiensten Filme heraus, die uns interessieren könnten. Sie generiert bei Chatbots die Antworten auf unsere Fragen. Und sie sorgt wegen Deep-Fakes immer wieder für negative Schlagzeilen.

KI macht den Alltag schön. Oder doch nicht?

Dabei handelt es sich um Videos oder Sprachaufnahmen, die durch eine KI künstlich generiert wurden. Im Juni 2022 kursierten etwa Gerüchte, dass ein von einer KI erzeugtes Video von Kiews Bürgermeister Vitali Klitschko im Gespräch mit Berlins Bürgermeisterin Giffey verwendet wurde. Ob das stimmt, ist wohl abschließend noch nicht ganz geklärt.

Das Medienunternehmen RTL Deutschland gab dagegen im April 2022 bekannt, mit Hilfe von KI die Stimmen der eigenen Moderatoren zu imitieren – mit dem Ziel, dass diese lebensecht wirkenden Deep-Fakes z.B. bei dem Nachrichtenportal ntv.de die Online-Texte vorlesen. Dazu haben sie sogar Microsoft ins Boot geholt. Text-to-Speech nennt sich die Neuerung. Über Sinn und Unsinn kann man getrost diskutieren. Mich erinnert das jedenfalls an Transkriptionsprogramme, bei denen (umgekehrt) Sprache in Text umgewandelt wird. Und damit sind wir bei meinem journalistischen Alltag angekommen.

Wo findet sich KI nun im Texter-Alltag?

Ich gebe es zu, ich nutze KI bei der Recherche. Denn auch Suchmaschinen funktionieren mittlerweile nach dem Prinzip eines neuronalen Netzwerks. Etwa wenn man dort die Begriffe „Künstliche Intelligenz was ist das?“ eingibt. Die KI sucht dann, in für einen Menschen nicht mehr überschaubaren Datensätzen, gezielt wichtige Informationen zu meinen Suchbegriffen heraus.

KI übersetzt darüber hinaus Texte automatisch in eine andere Sprache. Oder sie wandelt O-Töne (etwa aus Interviews oder Videos) in eine Textdatei um – ohne, dass ich selbst etwas abtippen muss (wenn man einmal von den Umwandlungsfehlern absieht). Doch kann KI auch selbständig einen Text schreiben, der sich flüssig liest? Kurz gesagt: Ja, sie kann.

Was geht mit KI?

Es gibt schon diverse Tools, die Datenbanken bzw. das Internet durchforsten und anhand der gefundenen Informationen einen natürlich anmutenden Fließtext erstellen können. Oft wird in diesem Zusammenhang das neuronale Transformer-Modell GPT-3 genannt (Generative Pre-Training Transformer 3). Und es soll richtig gut sein, verwendet Sprachmuster, die das Modell statistisch berechnet hat. Vielleicht wird GPT-3 sogar mal in einem Dialekt schreiben können, wenn dieser grammatikalischen Regeln folgt. Sprache ist schließlich Sprache. Egal, ob die KI nun Kartoffeln in Potatoes, Pommes de terre oder Grommbira übersetzt.

Und was geht nicht?

Dennoch bin ich der Meinung, dass KI in absehbarer Zeit keine professionellen Texter bzw. Journalisten ersetzen kann. Unabhängig davon, wie groß die Rechenleistung eines Großcomputers, oder wie zahlreich die Schichten seines künstlichen neuronalen Netzwerks sind. Denn KI muss immer auf bereits vorhandene Datensätze zurückgreifen, auf Bilder (siehe auch den Blogbeitrag Wenn künstliche Intelligenz zum Maler oder Zeichner wird), Videos, Audios oder Texte. Sie kann diese digitalen Informationen zwar selbstständig analysieren und verknüpfen, dennoch muss dieses Wissen schon vorhanden sein. Kreativität, Einfühlungsvermögen und Mitgefühl (nötig etwa für Features oder Porträts), das kann sie noch nicht.

Man kann ihren Datenschatz vielleicht mit einer großen Bibliothek vergleichen, in der das Wissen in Tausenden von Büchern enthalten ist. Manche Bücher sind klug geschrieben, manche weniger. Manche Autoren wagen steile Thesen, sind mutig, innovativ oder haben bereits vorhandenes Wissen noch einmal zusammengestellt (tertiäre Literatur). Sicherlich wird die KI dabei v.a. Letzteres stärker bewerten, da die tertiäre Literatur öfter in anderen Publikationen zitiert werden wird. Natürlich spielen noch andere Kriterien mit hinein, wie Schlüsselwörter oder ähnliches. Doch im Grunde gilt für sie: Je häufiger etwas zitiert/gelikt/weitergeleitet wird, desto wichtiger muss es sein.

Fehler macht jeder – auch die KI

Dass dies ein Problem werden kann, beweisen zahlreiche Fake-News. Denn manchmal lässt sich nur durch Erfahrung oder Intuition bewerten, wie die Quellen der Zitate einzuordnen sind. Hier wird das künstliche neuronale Netzwerk meiner Meinung nach eher scheitern. Wie auch bei eher subjektiven Texten wie dem Kommentar, bei denen vorhandenes Wissen vom Autor abgewogen und eingeordnet wird.

Ein weiteres Problem: Wenn natürlich anmutende, von einer KI generierte Texte nicht entsprechend gekennzeichnet sind, besteht die Gefahr, dass die falsch interpretierten Inhalte weitergeleitet werden, ohne dass die Leser wissen, wer die eigentliche Quelle ist. Das gilt natürlich auch für Videos oder Podcasts. Eine Kennzeichnung sollte daher bei KI-generieren Texten ebenso Pflicht sein, wie bei gesponserten Beiträgen. Doch werden sich alle daran halten?

Auch wird die Künstliche Intelligenz wohl nicht bemerken, wenn die ihr vorliegenden Informationen lückenhaft sind. Sie ist letztendlich auf Output ausgelegt. Und sie kann nicht erkennen, wann sie hinter die Fakten schauen und die richtigen (kritischen) Fragen stellen muss, oder ob sie sich einen Interviewpartner zu einem Thema suchen sollte. Sie schreibt einfach. Expertenwissen ist aber oft mehr, als reines Fachwissen. Manchmal sind die wichtigen oder interessanten Fakten unter der Oberfläche versteckt. Das habe ich z.B. bei meinem Kepler-Porträt bemerkt.

Überhaupt denke ich, dass ein künstliches Netzwerk nicht fähig ist, Zitate aus einem Interview sachlich korrekt in einen Text einzubauen. Eine wichtige Aufgabe für Journalisten. Ob ein Algorithmus das jemals kann?

Auch ganz wichtig

Eine KI ist immer nur so gut, wie die ausgewählten Datensätze, mit denen sie trainiert wurde. Einseitige, geschlechterdiskriminierende und rassistisch eingefärbte Basis-Daten werden immer zu Verzerrungen (Bias) führen. Bestes Beispiel sind Instagram oder Tiktok, und ihre Wirkung auf die Selbstwahrnehmung von jungen Frauen (und vermutlich auch Männern). Sex sells.

Mein persönliches Resümee

KI „schreibt“ schon relativ erfolgreich z.B. den Wetterbericht, fasst Sport- oder Börsendaten in einem Text zusammen. Was aber wäre der Bericht über ein Fußball-Endspiel ohne das Herzblut eines Reporters, die Beschreibung des letzten Tores in der Verlängerung? Oder die Einordnung der Börsendaten in das aktuelle Wirtschaftsgeschehen? Für solche Texte würde ich den häufig so genannten Roboterjournalismus wohl nicht einsetzen. Auch nicht für Beiträge, bei denen Feingefühl, ein persönlicher Blickwinkel und fachliche Erfahrung gefragt sind, etwa bei Themen im Bereich Soziales, Medizin oder Forschung.

Bei der Hintergrundrecherche oder für Datenjournalisten sind trainierte Algorithmen dagegen sehr hilfreich (z.B. bei den Panama-Papers). Etwa bei der Suche in Archiven, Publikationen, Akten, Datensätzen oder in den unendlichen Weiten des WWW.

Zusammengefasst, eignet sich Künstliche Intelligenz meiner Meinung nach z.B. für:

-

• den Wetterbericht

• Sportergebnisse

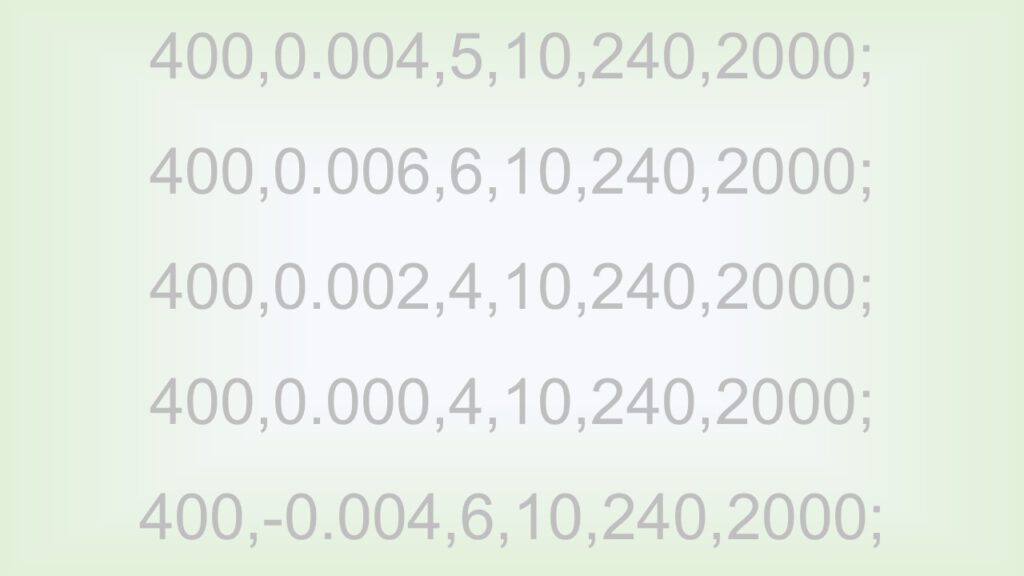

• Börsenkurse

• strategische Unternehmensblogs

• Tutorials

• Wahlergebnisse

• Datenjournalismus

• Hintergrundrecherchen

• die Zusammenstellung von Informationen für rein fakten-basierte Berichte und Newsletter.

Nicht aber:

-

• für subjektive Reportagen, Features oder Hintergrundberichte

• in Porträts

• im Bereich Soziales

• für Life-Science-Texte

• für Interviews

• bei meinungsbetonten Darstellungsformen wie Kommentaren, Kolumnen oder in einer Theaterkritik

• bei anspruchsvollen Themen, die eine ausführliche Recherche erfordern

• bei Informationen und Forschungsergebnissen, die eine fachliche Einordnung erfordern

• bei Texten, die einen anderen Blickwinkel haben, oder denen man einen „anderen Dreh“ geben möchte.

Was mein Fachgebiet Life Science angeht: Gerade während der ersten Covid-Monate hat sich gezeigt, wie wichtig es ist, Geduld zu haben, bei neuen Informationen genauer hinzuschauen, Forschungsergebnisse zu analysieren, abzuwägen und einzuordnen, den Interviewpartner nach bestem Wissen auszuwählen.

Auch ist eine KI nicht in der Lage, ihre eigenen Fehler zu bemerken oder selbst zu berichtigen (ich sage nur Autokorrektur). Für die redaktionelle Überarbeitung und Korrektur der so generierten Beiträge wird immer ein biologisches Wesen nötig sein. Qualitätsjournalismus ist damit ein adäqater Weg, um sich von der KI abzugrenzen. Überflüssig werden menschliche Journalisten also in absehbarer Zeit wohl nicht.

Fun Fact am Ende: meine Fingerbewegungen sind beim Tippen durch jahrelange Übung natürlich ebenfalls automatisiert. Dennoch funktioniert meine Bewegungsplanung beim Wort neurolane Netzwerke nicht wirklich. Es stimmt schon, Kreativität kommt oft voll ganz allein … ;o) …

(Und, wer hat die beiden Schreibfehler im letzten Abschnitt gefunden?)

Update zum Einsatz von KI im Journalismus

Die folgenden Links sind für manch treuen KI-Fan vielleicht gänzlich „old school“, aber dennoch immens wichtig, damit uns auch künftig unabhängige und glaubwürdige Informationen zur Verfügung stehen:

1. Der Deutsche Journalistenverband (DJV) vertritt folgende Positionen beim Einsatz von KI im Journalismus. Diese Liste unterstütze ich und werde diese Positionen, soweit es mir möglich ist, auch selbst auf meiner Website umsetzen.

2. Die komplette „Paris-Charta zu KI und Journalismus“ findet sich hier (übersetzt vom DJV). Wäre es möglich, würde ich sie als Freie ebenfalls unterzeichnen.

Letztes Update: 18.07.2024